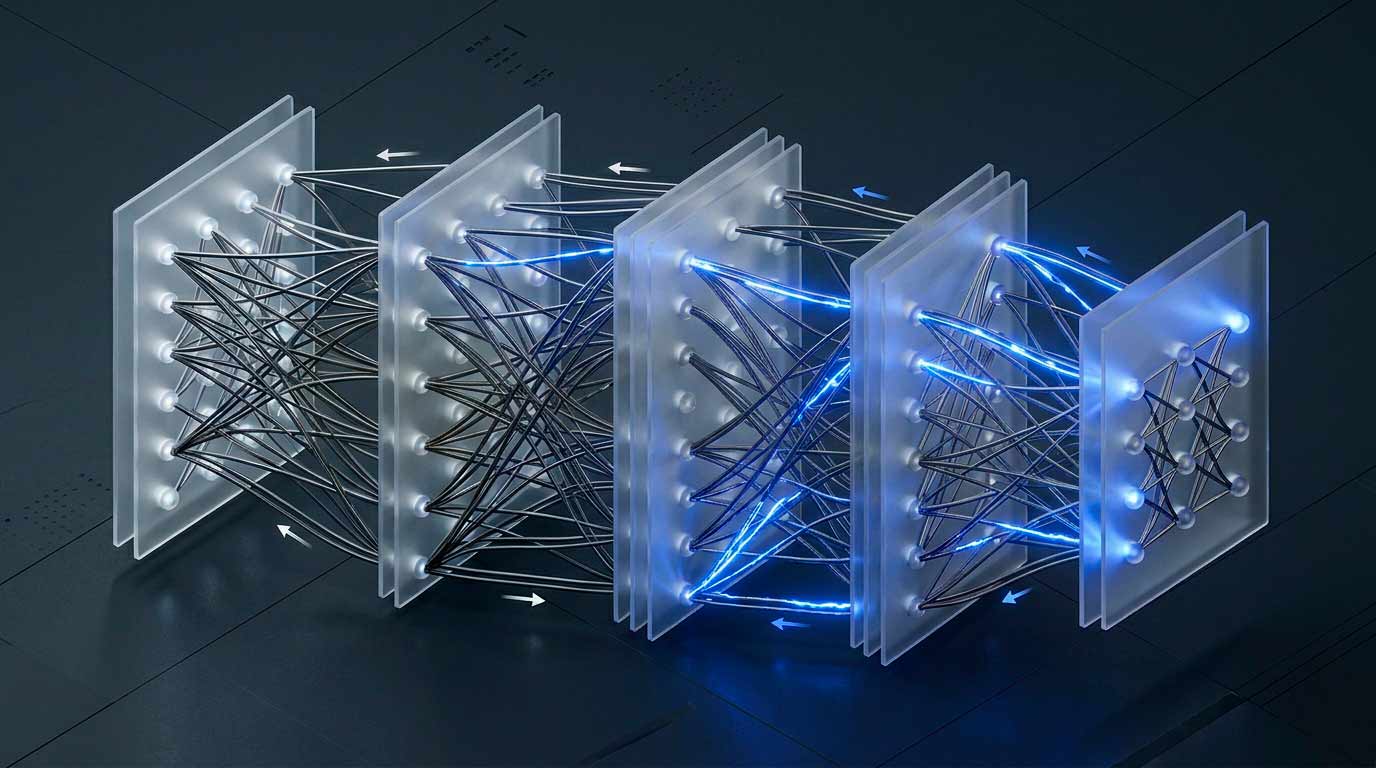

Зворотне поширення помилки (backpropagation) у нейронних мережах — це алгоритм навчання з учителем, який використовується для налаштування моделей шляхом обчислення того, як помилки мають коригувати внутрішні ваги через градієнтну оптимізацію. З технічної точки зору це ефективна реалізація автоматичного диференціювання в зворотному режимі (reverse-mode autodiff), що дозволяє нейронним мережам обчислювати градієнти на великій кількості шарів із високою обчислювальною ефективністю. Це ключовий механізм, завдяки якому нейронні мережі навчаються на даних і з часом покращують точність своїх прогнозів.

Зворотне поширення помилки (backpropagation) — основний алгоритм навчання штучних нейронних мереж, який обчислює градієнт функції втрат відносно ваг моделі. Він належить до методів навчання з учителем і виступає базовим математичним механізмом оптимізації. У сучасній AI-індустрії backpropagation лежить в основі навчання більшості моделей глибокого навчання, включаючи мовні моделі та системи комп’ютерного зору.

Просте пояснення зворотного поширення помилки

Уявіть, що ви навчаєтесь грати у складну відеогру, де контролер має сотні незрозумілих кнопок. Ви натискаєте їх у певній послідовності (це прямий прохід — Forward Pass), і персонаж падає в яму. Ви програли рівень (це помилка — Loss). Щоб покращити результат, ви не просто хаотично натискаєте кнопки, а аналізуєте свої дії. Ви розумієте, що помилка сталася не лише в останньому стрибку, а, наприклад, через неправильний напрямок, заданий кількома секундами раніше. Ви «поширюєте» причину помилки назад по ланцюгу дій, щоб зрозуміти, що саме потрібно змінити. В AI алгоритм backpropagation працює аналогічно — він визначає, які внутрішні зв’язки призвели до неправильного результату.

Як працює зворотне поширення помилки

Навчання нейронної мережі — це ітеративний процес. Щоб зрозуміти принципи зворотного поширення помилки, важливо розглянути основні етапи одного кроку навчання, детальніше описані в розділі навчання ШІ:

- Прямий прохід (Forward Pass): дані проходять через шари мережі. Кожен шар виконує обчислення з використанням ваг і зміщень, після чого результат проходить через функцію активації (наприклад, ReLU) і формується прогноз.

- Обчислення помилки (Loss Calculation): модель порівнює свій прогноз із правильним значенням. Різниця вимірюється функцією втрат — чим вона більша, тим сильніше модель помиляється.

- Зворотний прохід (Backward Pass): алгоритм рухається від виходу до входу та за допомогою правила ланцюга визначає внесок кожної ваги у фінальну помилку.

Як працює зворотне поширення помилки крок за кроком

- Прямий прохід: вхідні дані проходять через нейронну мережу і формують прогноз.

- Обчислення помилки: прогноз порівнюється з реальним значенням за допомогою функції втрат.

- Зворотний прохід: алгоритм backpropagation обчислює градієнти, визначаючи внесок кожної ваги у помилку.

- Оновлення ваг: алгоритм оптимізації (наприклад, Gradient Descent) коригує ваги, щоб зменшити помилку в майбутньому.

Алгоритм зворотного поширення помилки часто плутають із градієнтним спуском (Gradient Descent), але це різні речі. Зворотне поширення помилки обчислює градієнти, а Gradient Descent використовує їх для оновлення ваг. Разом вони дозволяють моделі поступово покращуватися в процесі навчання. Одним із обмежень є проблема затухаючого градієнта (Vanishing Gradient Problem), коли градієнти стають надто малими, і ранні шари перестають навчатися. Зазвичай це вирішується за допомогою архітектурних підходів, таких як Batch Normalization.

Приклад зворотного поширення помилки

Уявіть модель класифікації зображень, яка помилково визначає кота як собаку. У процесі навчання алгоритм backpropagation аналізує цю помилку та визначає, які ваги призвели до неправильного результату. Потім він коригує їх, щоб модель давала точніші прогнози в майбутньому. Саме так нейронні мережі поступово підвищують свою точність.

Де використовується зворотне поширення помилки

Алгоритм backpropagation лежить в основі практично всіх сучасних AI-систем. Для більш точного розуміння базових понять можна звернутися до глосарію ШІ. Основні сфери застосування:

- Медична візуалізація: навчання моделей для виявлення аномалій на рентгенівських знімках і МРТ з високою точністю.

- Автономний транспорт: системи безпілотного водіння використовують backpropagation для покращення моделей сприйняття.

- Обробка природної мови: навчання великих мовних моделей, які аналізують величезні обсяги текстових даних.

Чому це важливо

До широкого впровадження зворотного поширення помилки (backpropagation) навчання глибоких нейронних мереж вважалося практично неможливим. Сьогодні цей алгоритм залишається ключовим елементом сучасних AI-архітектур, включаючи Transformer-моделі, на яких базуються системи на кшталт ChatGPT. Основні переваги:

- Ефективність: обчислює градієнти для всієї мережі за один зворотний прохід.

- Масштабованість: підходить для моделей із мільярдами параметрів.

- Автоматизація: сучасні фреймворки (PyTorch, TensorFlow) автоматично виконують обчислення через Auto-Diff.

| Параметр | Backpropagation | Gradient Descent |

|---|---|---|

| Основна роль | Обчислення градієнтів | Оновлення ваг |

| Напрямок | Назад (від виходу до входу) | До мінімуму функції втрат |

FAQ

Backpropagation — це і є навчання?

Ні. Навчання — це загальний процес. Backpropagation обчислює помилки, а оптимізатор (наприклад, Adam або SGD) оновлює ваги моделі.

Чи потрібно реалізовувати backpropagation вручну?

У більшості випадків — ні. Бібліотеки на кшталт PyTorch і Keras роблять це автоматично. Однак розуміння алгоритму важливе для налагодження моделей.

Що таке Backpropagation Through Time (BPTT)?

Це варіант алгоритму для рекурентних нейронних мереж (RNN), який дозволяє поширювати помилку через часові послідовності.

Чи можна використовувати його без функції втрат?

Ні. Без функції втрат неможливо обчислити помилку, а отже й градієнти для зворотного поширення.