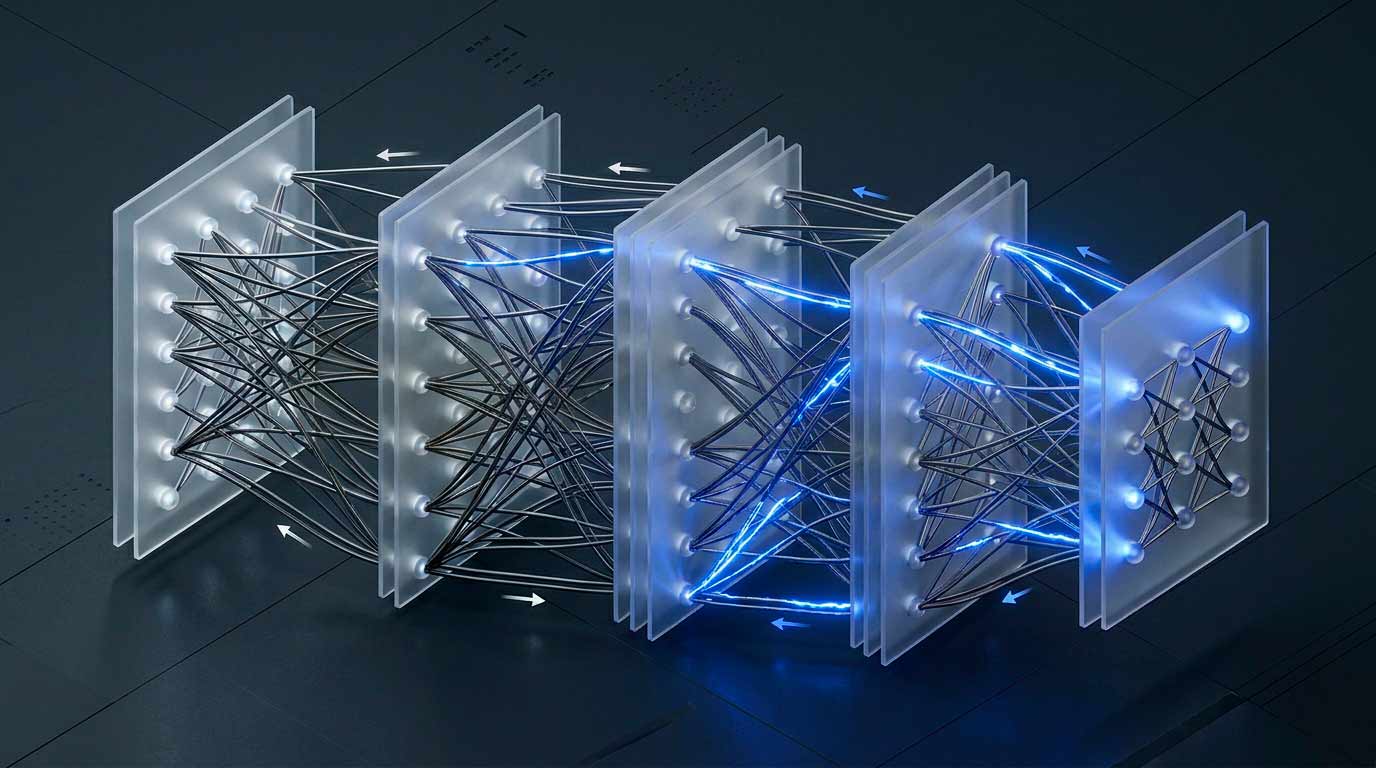

Обратное распространение ошибки (backpropagation) в нейронных сетях — это алгоритм обучения с учителем, который используется для настройки моделей за счёт вычисления того, как ошибки должны корректировать внутренние веса через градиентную оптимизацию. С технической точки зрения это эффективная реализация автоматического дифференцирования в обратном режиме (reverse-mode autodiff), позволяющая нейронным сетям вычислять градиенты на множестве слоёв с высокой вычислительной эффективностью. Это ключевой механизм, благодаря которому нейронные сети обучаются на данных и со временем улучшают точность своих предсказаний.

Обратное распространение ошибки (backpropagation) — основной алгоритм обучения искусственных нейронных сетей, который вычисляет градиент функции потерь по отношению к весам модели. Он относится к методам обучения с учителем и выступает базовым математическим механизмом оптимизации. В современной AI-индустрии backpropagation лежит в основе обучения большинства моделей глубокого обучения, включая языковые модели и системы компьютерного зрения.

Простое объяснение обратного распространения ошибки

Представьте, что вы учитесь играть в сложную видеоигру, где у контроллера сотни непонятных кнопок. Вы нажимаете их в определённой последовательности (это прямой проход — Forward Pass), и персонаж падает в яму. Вы проиграли уровень (это ошибка — Loss). Чтобы улучшить результат, вы не просто хаотично нажимаете кнопки, а анализируете свои действия. Вы понимаете, что ошибка произошла не только в последнем прыжке, а, например, из-за неправильного направления, заданного несколькими секундами ранее. Вы «распространяете» причину ошибки назад по цепочке действий, чтобы понять, что именно нужно изменить. В AI алгоритм backpropagation работает аналогично — он определяет, какие внутренние связи привели к неправильному результату.

Как работает обратное распространение ошибки

Обучение нейронной сети — это итеративный процесс. Чтобы понять принципы обратного распространения ошибки, важно рассмотреть основные этапы одного шага обучения, подробнее описанные в разделе обучение ИИ:

- Прямой проход (Forward Pass): данные проходят через слои сети. Каждый слой выполняет вычисления с использованием весов и смещений, после чего результат проходит через функцию активации (например, ReLU) и формируется предсказание.

- Вычисление ошибки (Loss Calculation): модель сравнивает своё предсказание с правильным ответом. Разница измеряется функцией потерь — чем она выше, тем сильнее модель ошибается.

- Обратный проход (Backward Pass): алгоритм движется от выхода к входу и с помощью правила цепочки вычисляет вклад каждого веса в итоговую ошибку.

Как работает обратное распространение ошибки шаг за шагом

- Прямой проход: входные данные проходят через нейронную сеть и формируют предсказание.

- Вычисление ошибки: предсказание сравнивается с реальным значением с помощью функции потерь.

- Обратный проход: алгоритм backpropagation вычисляет градиенты, определяя вклад каждого веса в ошибку.

- Обновление весов: алгоритм оптимизации (например, Gradient Descent) корректирует веса, чтобы снизить ошибку в будущем.

Алгоритм обратного распространения ошибки часто путают с градиентным спуском (Gradient Descent), но это разные вещи. Обратное распространение ошибки вычисляет градиенты, а Gradient Descent использует их для обновления весов. Вместе они позволяют модели постепенно улучшаться в процессе обучения. Одним из ограничений является проблема затухающего градиента (Vanishing Gradient Problem), при которой градиенты становятся слишком малыми, и ранние слои перестают обучаться. Обычно это решается архитектурными подходами, такими как Batch Normalization.

Пример обратного распространения ошибки

Представьте модель классификации изображений, которая ошибочно определяет кошку как собаку. В процессе обучения алгоритм backpropagation анализирует эту ошибку и определяет, какие веса привели к неверному результату. Затем он корректирует их, чтобы модель давала более точные предсказания в будущем. Именно так нейронные сети постепенно повышают свою точность.

Где используется обратное распространение ошибки

Алгоритм backpropagation лежит в основе практически всех современных AI-систем. Для более точного понимания базовых понятий можно обратиться к ИИ Глоссарию. Основные области применения:

- Медицинская визуализация: обучение моделей для обнаружения аномалий на рентгеновских снимках и МРТ с высокой точностью.

- Автономный транспорт: системы беспилотного вождения используют backpropagation для улучшения моделей восприятия.

- Обработка естественного языка: обучение больших языковых моделей, анализирующих огромные объёмы текстовых данных.

Почему это важно

До широкого распространения обратного распространения ошибки (backpropagation) обучение глубоких нейронных сетей считалось практически невозможным. Сегодня этот алгоритм остаётся ключевым элементом современных AI-архитектур, включая Transformer-модели, на которых основаны системы вроде ChatGPT. Основные преимущества:

- Эффективность: вычисляет градиенты для всей сети за один обратный проход.

- Масштабируемость: подходит для моделей с миллиардами параметров.

- Автоматизация: современные фреймворки (PyTorch, TensorFlow) автоматически выполняют вычисления через Auto-Diff.

| Параметр | Backpropagation | Gradient Descent |

|---|---|---|

| Основная роль | Вычисление градиентов | Обновление весов |

| Направление | Назад (от выхода к входу) | К минимуму функции потерь |

FAQ

Backpropagation — это и есть обучение?

Нет. Обучение — это общий процесс. Backpropagation вычисляет ошибки, а оптимизатор (например, Adam или SGD) обновляет веса модели.

Нужно ли реализовывать backpropagation вручную?

В большинстве случаев — нет. Библиотеки вроде PyTorch и Keras делают это автоматически. Однако понимание алгоритма важно для отладки моделей.

Что такое Backpropagation Through Time (BPTT)?

Это вариант алгоритма для рекуррентных нейронных сетей (RNN), который позволяет распространять ошибку через последовательности во времени.

Можно ли использовать его без функции потерь?

Нет. Без функции потерь невозможно вычислить ошибку, а значит и градиенты для обратного распространения.