Станом на березень 2026 року відсутні офіційні анонси, бенчмарки або технічна документація щодо наступної ШІ-моделі DeepSeek, що означає непідтвердженість її специфікацій. Спираючись на тренди масштабування, які спостерігалися в DeepSeek-V2, а також на порівнювані frontier-системи з архітектурою mixture-of-experts, прогнозовану продуктивність можна оцінити через ефективність розрідженого масштабування та орієнтири класу MLCommons для інференсу. Цей матеріал є технічним прогнозом, а всі показники продуктивності та інфраструктури подані як інженерні оцінки (~Value est.).

- Прогнозована загальна кількість параметрів: ~1,0–1,3 трлн (оцінка), офіційні бенчмарки наразі відсутні

- Прогнозована пропускна здатність інференсу: ~350–500 токенів/сек на вузол класу NVIDIA H100 (оцінка), залежно від частки активованих експертів

- Прогнозований обчислювальний бюджет навчання: >5e25 FLOPs сумарно (оцінка), відповідно до законів масштабування розріджених моделей трильйонного класу

Операційні параметри

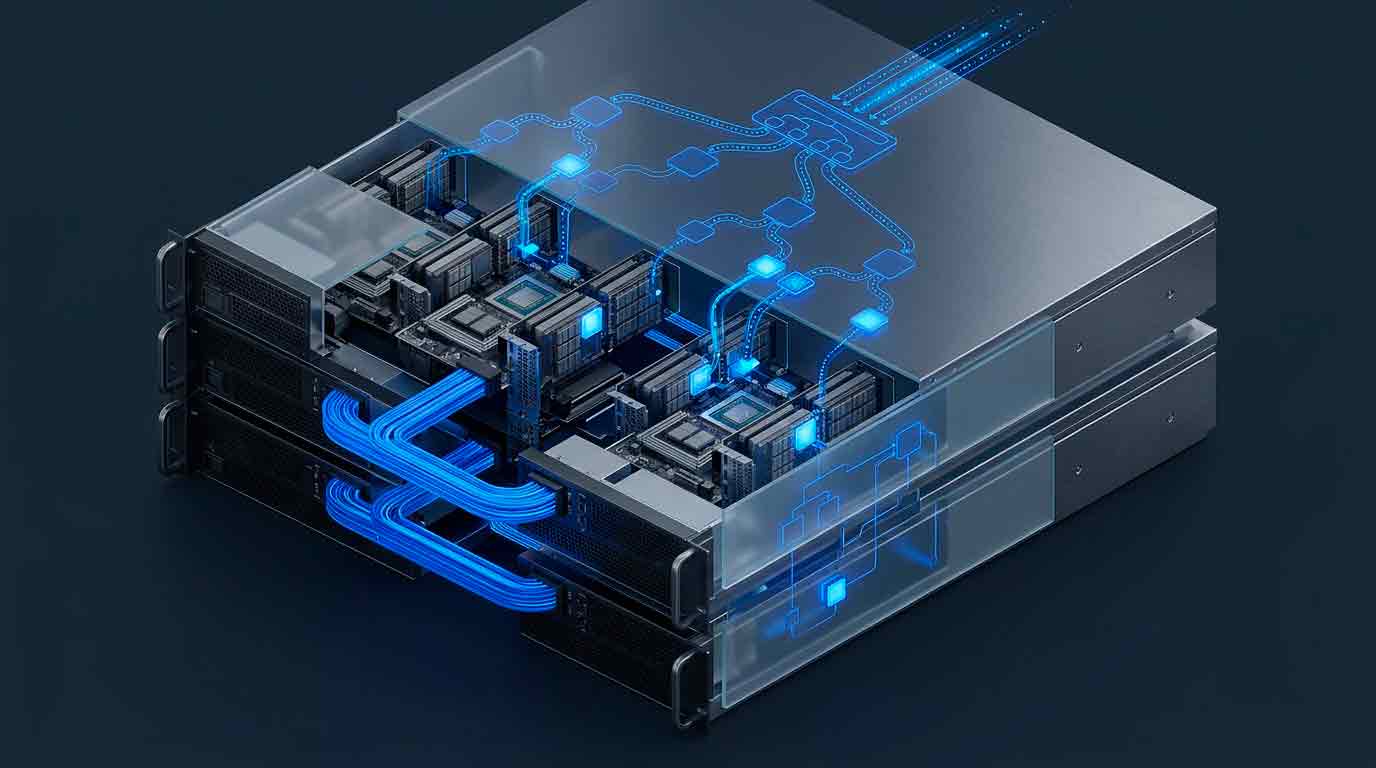

- Енергетичне навантаження: навчання та експлуатація розрідженої моделі з трильйоном параметрів, за прогнозом, вимагатимуть стабільної щільності енергоспоживання на рівні ~80–120 кВт на стійку (оцінка), що стимулює впровадження рідинного охолодження «безпосередньо до чипа» та високоефективних систем електроживлення.

- Обчислювальна щільність: архітектура sparse mixture-of-experts дозволяє активувати лише ~5–10% загальної кількості параметрів на один токен, забезпечуючи зростання ефективного масштабу моделі без пропорційного збільшення обчислень і вищу продуктивність на ват порівняно з щільними архітектурами.

- Стратегічні терміни: темпи впровадження значною мірою залежатимуть від доступності прискорювачів, постачання високошвидкісних міжз’єднань і зрілості кластерної інтеграції; орієнтовний цикл розгортання — 6–12 місяців після завершення первинного навчання моделі.

Архітектура маршрутизації

Прогнозована система, ймовірно, розвиває ієрархічну маршрутизацію mixture-of-experts, поєднуючи розріджені експертні feedforward-шари зі спільною «основою» механізму уваги. Токени динамічно спрямовуються до обмеженої підмножини експертів, що зменшує обсяг активних обчислень при збереженні загального масштабу параметрів. Продуктивність критично залежить від пропускної здатності міжз’єднань, балансування навантаження між експертами та ефективності доступу до пам’яті в розподілених GPU-кластерах.

Профіль продуктивності

Розріджені моделі трильйонного класу зміщують ключові обмеження продуктивності з чистої обчислювальної потужності на пропускну здатність пам’яті та ефективність міжз’єднань. Порівняно зі щільними моделями, такі системи забезпечують вищу пропускну здатність на одиницю обчислень, але потребують складнішої оркестрації та планування. Цей архітектурний зсув безпосередньо впливає на проєктування дата-центрів, економіку інференсу та стратегії використання прискорювачів.

| Модель | Архітектура | Активні параметри на токен | Статус |

|---|---|---|---|

| DeepSeek (прогноз) | Розріджена MoE | ~50–100 млрд (оцінка) | Прогноз |

| DeepSeek-V2 | Розріджена MoE | ~20–40 млрд | Випущена |

| Клас GPT-4 | Щільна / гібридна (не розкрито) | Не розкрито | Випущена |

| Gemini 1.5 Pro | Розріджена / гібридна | Не розкрито | Випущена |

З точки зору CTO, розріджені архітектури трильйонного класу зміщують вузьке місце масштабування з обчислювальної потужності на пропускну здатність міжз’єднань, ефективність пам’яті та стабільність розподілених систем.

Аналітика Ainformer

Прогнозована наступна модель DeepSeek відповідає галузевому переходу до розрідженого масштабування як домінуючого методу розвитку frontier-ШІ. Замість лінійного збільшення обчислень зі зростанням розміру моделі розріджена маршрутизація дозволяє експоненційно збільшувати кількість параметрів, зберігаючи прийнятні експлуатаційні витрати та затримки інференсу.

У разі успішного розгортання така система може посилити регіональну технологічну незалежність у сфері ШІ та прискорити впровадження великомасштабних автономних систем. Ключовим обмежувальним фактором стане не стільки дизайн моделі, скільки доступність високошвидкісних прискорювачів, ефективних кластерних мереж і інфраструктури електроживлення та охолодження дата-центрів, необхідних для безперервної роботи.