GPT-5.4 Mini and Nano от OpenAI представлены как компактные модели ИИ, предназначенные для лёгких сценариев использования, с доступностью через платформу Microsoft Azure AI Foundry. По данным компаний, релиз ориентирован на снижение задержки, повышение эффективности затрат и гибкость развертывания в экосистеме AI новостей.

GPT-5.4 Mini and Nano что изменилось

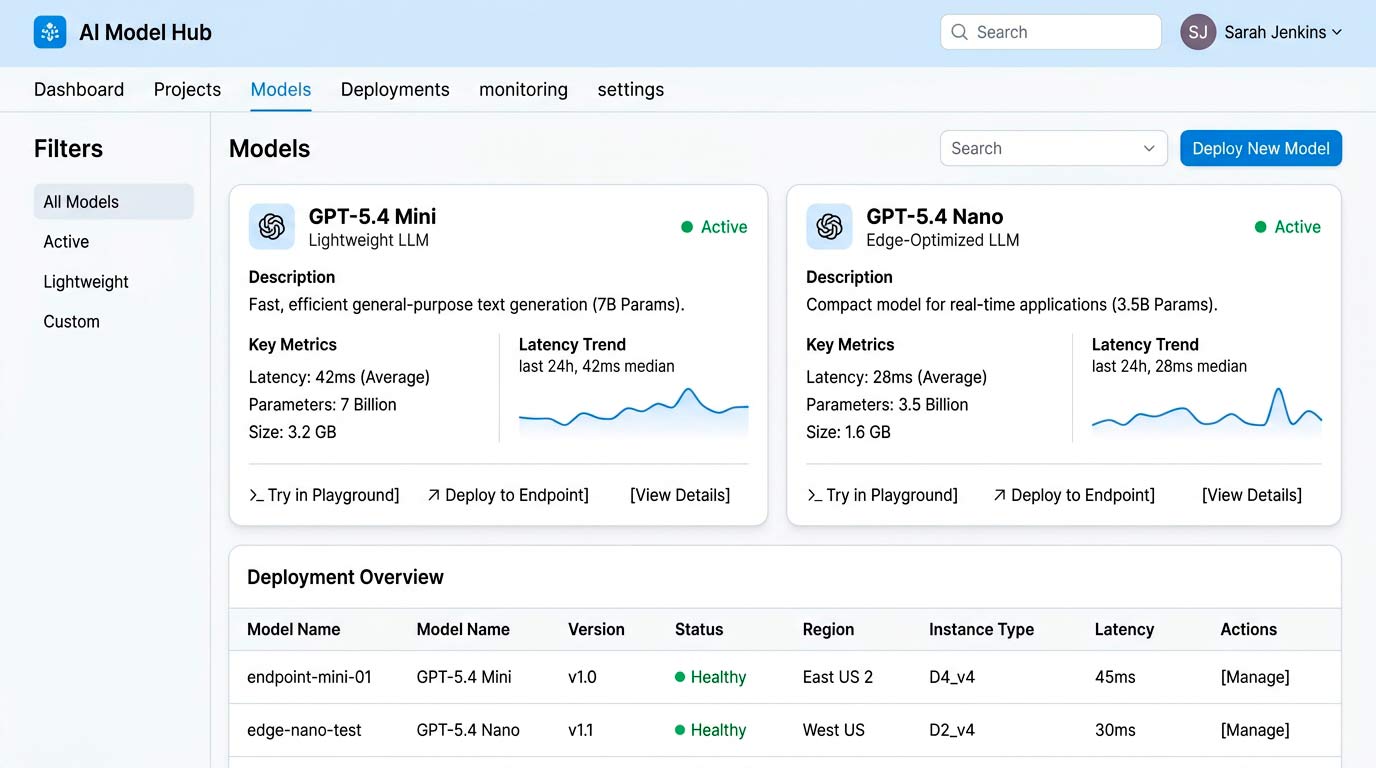

OpenAI объявила о выпуске GPT-5.4 Mini и GPT-5.4 Nano в рамках семейства GPT-5.4, позиционируя их как более эффективные альтернативы крупным моделям. По заявлению компании, новые модели ориентированы на более быстрый отклик и снижение вычислительных затрат.

Microsoft также подтвердила, что обе модели доступны через Azure AI Foundry, где они интегрированы в платформу для разработчиков и корпоративных пользователей.

Ключевые изменения в новых лёгких моделях

- Появление двух компактных моделей

- Фокус на низкой задержке и снижении потребления ресурсов

- Доступность через Azure AI Foundry для корпоративного использования

- Дальнейшее развитие стратегии сегментации моделей OpenAI

OpenAI описывает новые модели как подходящие для задач, где приоритетом являются скорость и эффективность, а не максимальная вычислительная мощность.

Технические детали лёгких моделей

Подробности об архитектуре или бенчмарках в предоставленных источниках не раскрываются. Согласно материалам релиза, GPT-5.4 Mini and Nano занимают нишу облегчённых решений в линейке GPT-5.4.

По данным Microsoft, модели рассчитаны на такие сценарии, как:

- Реалтайм-приложения с низкой задержкой

- Высоконагруженные системы

- Сценарии с ограниченным бюджетом

Интеграция в Azure AI Foundry также указывает на более тесную связку с корпоративными AI-инструментами Microsoft.

Почему новые модели важны

Релиз демонстрирует, как OpenAI сегментирует линейку моделей под разные сценарии использования, вместо универсального подхода. Для разработчиков это означает возможность выбора моделей, где важны скорость отклика и стоимость, а не максимальные возможности. Подробнее о сценариях применения можно прочитать в обзоре сценариев использования.

Для компаний, уже использующих Azure AI Foundry, появление этих моделей может упростить внедрение более лёгких решений в существующую инфраструктуру.

Реакция индустрии на релиз

Первые обсуждения на Reddit показывают смешанную реакцию сообщества. Некоторые пользователи считают модели практичными для узких задач, тогда как другие задаются вопросом о компромиссах между эффективностью и возможностями по сравнению с более крупными моделями.

Такая реакция отражает типичную дилемму в развитии ИИ: снижение задержки и стоимости привлекательно, но разработчикам важно понимать ограничения по производительности.