Gemini 3.1 Flash-Lite — це нова генеративна модель штучного інтелекту від Google. Вона створена для забезпечення швидких відповідей і зниження витрат для розробників та компаній, які використовують AI-системи у масштабних обчислювальних навантаженнях.

Новий реліз розширює сімейство великих мовних моделей Gemini (LLM). Водночас він відображає прагнення Alphabet зміцнити свої позиції на швидко зростаючому ринку генеративного штучного інтелекту. При цьому такі конкуренти, як OpenAI, Anthropic, Meta та Microsoft, також активно працюють над створенням швидших і ефективніших AI-систем.

Gemini 3.1 Flash-Lite створена для високонавантажених AI-обчислень

За даними Google, Gemini 3.1 Flash-Lite розроблена для застосунків, які обробляють велику кількість запитів до штучного інтелекту. Основна мета — забезпечити низьку затримку та передбачувані витрати на інфраструктуру.

Сьогодні подібні навантаження стають дедалі поширенішими. Компанії впроваджують генеративний ШІ у системи підтримки клієнтів, інструменти підвищення продуктивності, аналітичні платформи та корпоративні рішення для автоматизації.

Модель доступна через Gemini API, Google AI Studio та Vertex AI на платформі Google Cloud. Завдяки цьому розробники можуть інтегрувати її у чат-інтерфейси, інструменти автоматизації та корпоративні застосунки.

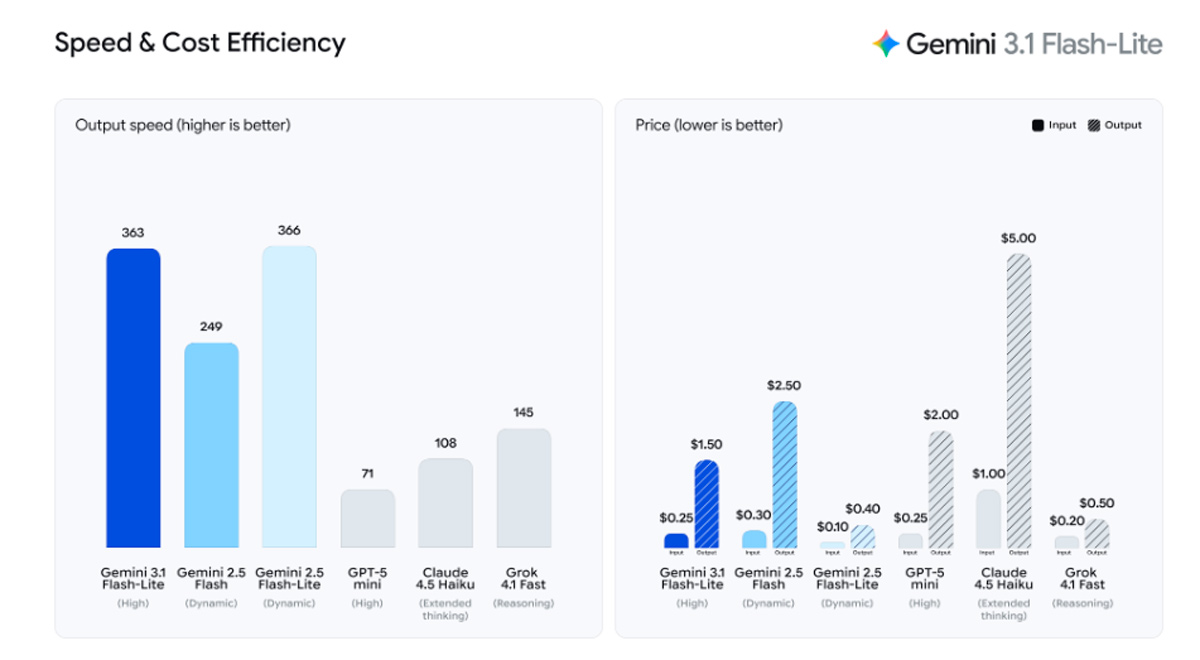

За словами Google, модель забезпечує швидші відповіді порівняно з попередніми версіями Flash. При цьому вона зберігає потужні можливості у сфері розуміння природної мови, логічного мислення та допомоги в програмуванні.

Ключові можливості моделі Gemini 3.1 Flash-Lite

Модель призначена для використання у production-середовищі, де особливо важливі продуктивність і ефективність.

- Оптимізація для високонавантажених AI-обчислень

- Зниження операційних витрат для корпоративних впроваджень

- Підтримка перекладу, узагальнення тексту та автоматизованих робочих процесів

- Інтеграція з інфраструктурою Google Cloud і Vertex AI

- Гнучке налаштування рівня міркування для балансу між швидкістю та якістю відповіді

Розробники можуть регулювати рівень міркування моделі залежно від складності задачі. Це дозволяє знаходити баланс між обчислювальними витратами та якістю згенерованих відповідей.

Ціноутворення для масштабованої AI-інфраструктури

Однією з ключових переваг моделі є її економічність. За даними Google, цінова модель орієнтована на організації, які обробляють мільйони AI-запитів щодня.

Вартість становить приблизно $0,25 за мільйон вхідних токенів і $1,50 за мільйон вихідних токенів. Це робить модель однією з доступніших серед рішень, призначених для масштабних обчислень.

Аналітики також зазначають, що ринок генеративного ШІ поступово зміщується у бік ефективності інференсу. Компанії дедалі менше фокусуються на створенні все більших моделей і більше — на масштабованій інфраструктурі.

«Гонка у сфері штучного інтелекту дедалі більше зміщується у бік економічного інференсу та масштабованої інфраструктури», — зазначають аналітики. «Компаніям, які впроваджують генеративний ШІ у production, потрібні моделі, здатні обробляти величезні обсяги запитів без різкого зростання обчислювальних витрат».

Google розширює екосистему Gemini

Запуск Gemini 3.1 Flash-Lite є частиною ширшої стратегії Google щодо розвитку платформи Gemini. Компанія продовжує розширювати лінійку моделей, оптимізованих для різних рівнів продуктивності та вартості.

Google також інтегрує Gemini у свою екосистему, включно з Google Cloud, Workspace, Search, Android та інструментами для розробників. У результаті Gemini стає ключовим елементом інфраструктурної стратегії компанії у сфері штучного інтелекту.

Спеціалізовані моделі, такі як Flash-Lite, призначені для повсякденних AI-застосунків. Серед них — чат-боти, інструменти підвищення продуктивності та корпоративні системи автоматизації.

Ефективність стає новим полем конкуренції на ринку AI-моделей

Запуск моделі також підкреслює ширшу трансформацію індустрії генеративного штучного інтелекту. Раніше конкуренція була зосереджена на створенні максимально потужних великих мовних моделей.

Сьогодні технологічні компанії активно інвестують у більш ефективні AI-системи. Такі моделі оптимізуються для швидкості роботи, масштабованості та зниження вартості інференсу.

Компанії, зокрема Google, OpenAI, Anthropic і Meta, активно розробляють полегшені AI-моделі, здатні обробляти мільйони користувацьких запитів щодня.

Для Google розширення лінійки Gemini також може посилити використання інфраструктури Google Cloud для штучного інтелекту.

Водночас читачі, які цікавляться розвитком галузі, можуть ознайомитися з останніми новинами AI та оновленнями індустрії, де публікуються матеріали про нові моделі, стартапи та технологічні тренди.

У міру того як компанії переходять від експериментів до промислового використання ШІ, такі ефективні моделі, як Gemini 3.1 Flash-Lite, ймовірно, відіграватимуть дедалі важливішу роль у глобальній AI-інфраструктурі.